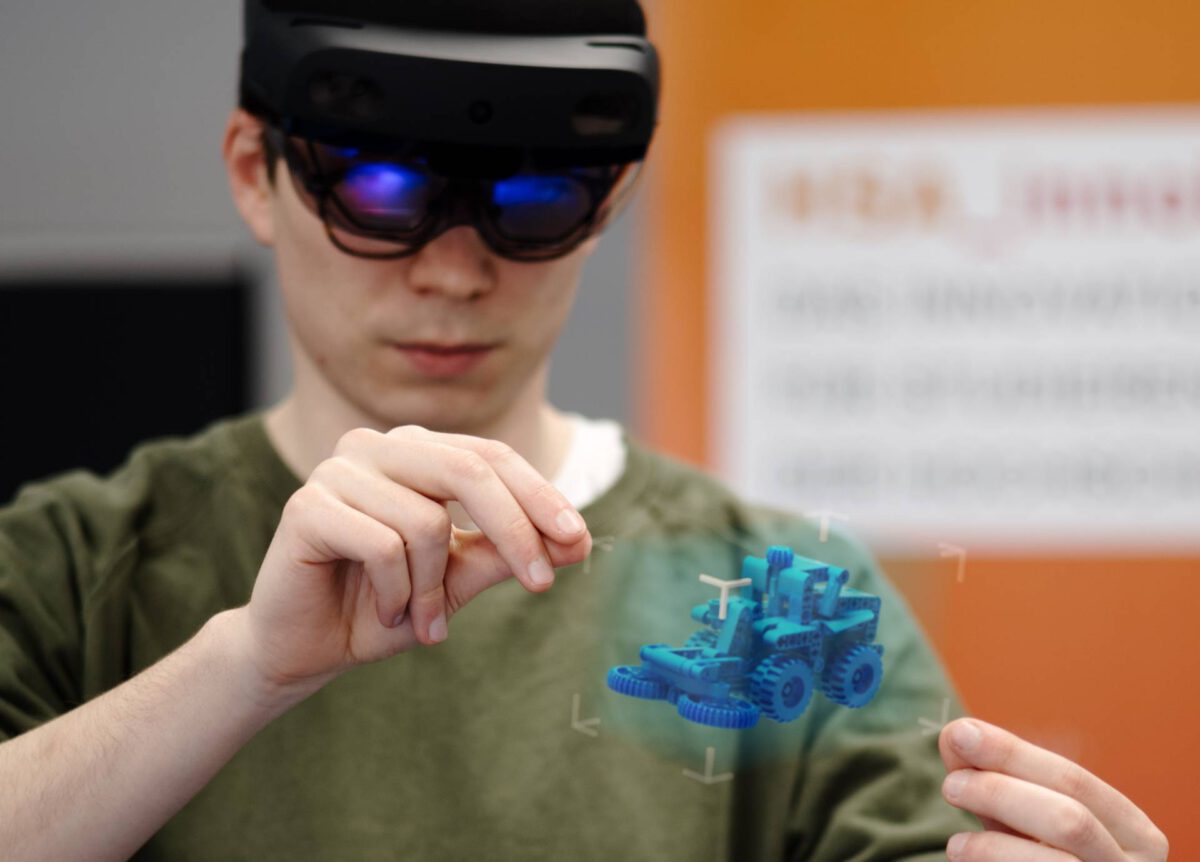

Mit zunehmendem technologischen Fortschritt und immer höherem Automatisierungsgrad von Aufgaben steigt die Verbreitung kollaborativ arbeitender Roboter. Diese sind fähig direkt mit Menschen zusammenzuarbeiten und benötigen im Gegensatz zu traditionellen Industrierobotern keine aufwändigen Schutzvorrichtungen. Neben der Erreichung einer hohen Qualität bei Aufgabenausführung ist es hier besonders wichtig die Interaktion mit den Menschen in den Vordergrund zu stellen.

In dieser Arbeit wurden verschiedene Methodiken zur Analyse und Verbesserung der Interaktionsqualität in Mensch-Roboter-Kollaborationsanwendungen entworfen. Sie sind im Anschluss dazu verwendet worden das Robotersystem RoboJack zu entwickeln. Dieses übernimmt im Spiel BlackJack die Aufgaben eines Dealers.

Die zentrale Idee hinter der Entwicklung der Kriterien zur Gestaltung hochwertiger Mensch-Roboter-Interaktionen war einen möglichst allgemeinen und ganzheitlichen Leitfaden zu entwerfen, welcher im Anschluss dazu verwendet werden kann eine detailliertere Entwicklungs-Checkliste für ein spezialisiertes System aufzustellen. Die acht Kriterien werden im Folgenden in verkürzter Form aufgezählt teilweise erweitert um konkrete Entwicklungsumsetzungen bei RoboJack.

Kriterium 1: System arbeitet zuverlässig

Neben einer zuverlässigen Aufgabenausführung sollte das System auch selbständig Fehler erkennen können. Dies ermöglicht dem System Menschen um Hilfe zu bitten, wobei es Fehlerzustände möglichst eigenständig lösen sollte.

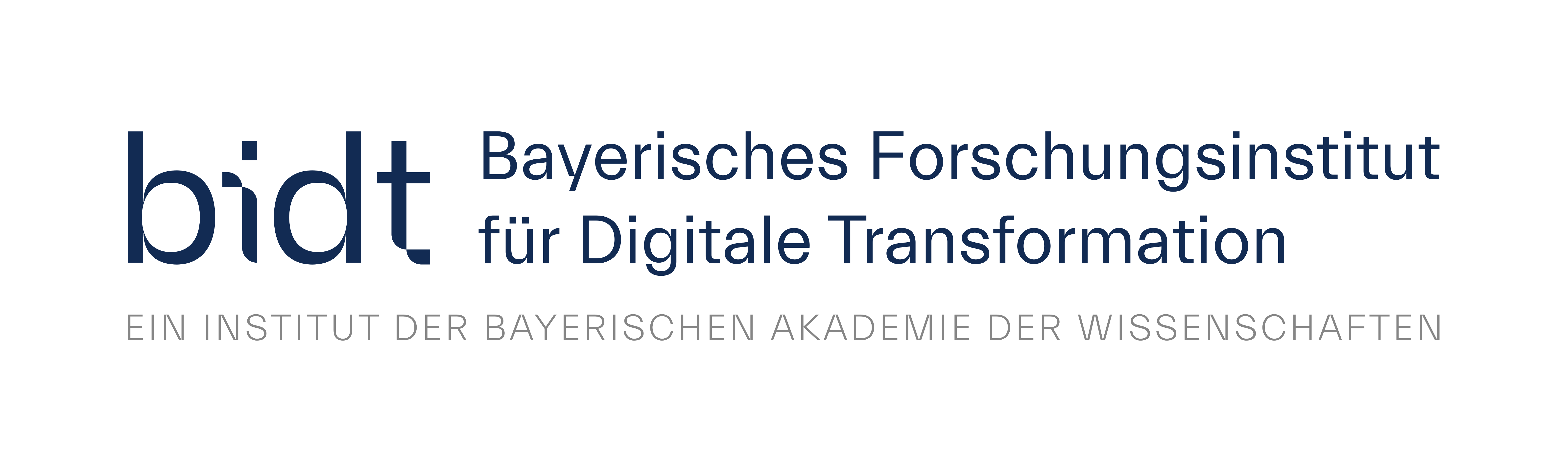

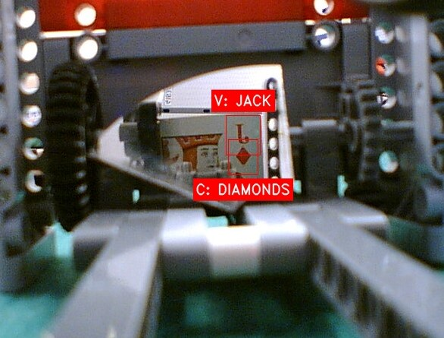

Bei den in RoboJack verwendeten KI-Modulen zur Erkennung von Spielkarten und Handgesten wurde beispielsweise darauf geachtet, dass diese eine sehr hoher Genauigkeit (100% für Karten und 98,6% für Gesten) erreichen. Falls irgendwelche Probleme auftreten die das System nicht selbständig lösen kann, etwa der Kartenmaschine die Karten ausgegangen sind oder ungültige Handgesten erkannt werden, gibt RoboJack den Nutzern über die Sprachausgabe Feedback.

Kriterium 2: Benutzer fühlen sich sicher vor dem Roboter

Hierzu zählt zum einen dass der Roboter genügend Abstand zu Personen hält. Als Einschätzungsbasis können hier die die vier persönlichen Distanzzonen für zwischenmenschliche soziale Interaktionen verwendet werden. Außerdem ist wichtig dass die stehenden Roboterposen natürlich aussehen, also ohne übermäßig verdrehte Achsen, und unbedrohlich wirken, wozu etwa zählt dass der Roboter falls er so etwas wie ein Gesicht besitzt, die Nutzer auf oder unter Augenhöhe und nicht von oben herab ansieht. Auch sollte der Roboter komplett sichtbar sein und nicht hinter sich selbst versteckt, damit Nutzer Bewegungen frühzeitig erkennen können. Zudem sollten ruckartige oder sehr schnelle Bewegungen vermieden werden, damit Anwender das Bewegungsziel erahnen können.

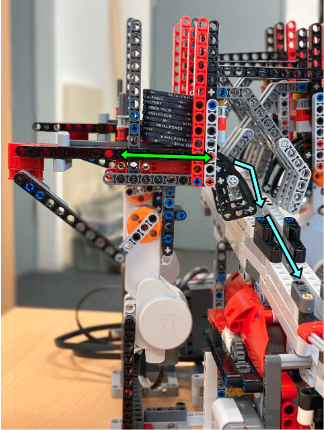

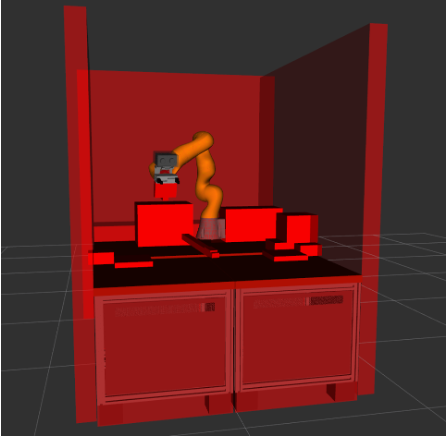

Beim Einmessen der Bewegungen von RoboJack wurden neben nach obigen Kriterien optimierten Roboterposen und langsamen Beschleunigungen auch darauf geachtet dass der Roboter einen Abstand von mehr als circa 1,2m zu Gesicht und Körper der Spieler hält. Zudem ist durch virtuelle Wände (im Bild ist die zwischen Roboter und Spielern ausgeblendet) ein sicherer Abstand zu den Spielern gewährleistet.

Kriterium 3: Roboter arbeitet nachvollziehbar

Hierzu zählen unter anderem sinnvolle Interaktionsmuster, möglichst direkte und flüssige Bewegungen die keine unnötigen Hilfspunkte enthalten und ein hilfreiches Nutzerfeedback.

Bei RoboJack wurden sämtliche Bewegungen wurden auf möglichst natürliche und fließende Art umgesetzt, nach dem Vorbild wie ein Mensch an der Stelle des Roboters diese ausführen würde. Zudem sagt RoboJack welche Karten er gerade austeilt und welche Handgesten er bei den Spielern erkannt hat, damit diese die Korrektheit des Spielablaufs eigenhändig überprüfen können.

Kriterium 4: Gleichwertige oder bessere Aufgabenausführung

Bei diesem Kriterium liegt der Fokus auf der Frage warum Nutzer den Roboter wählen sollten wenn ein Mensch an dessen Stelle die Aufgabe besser macht. Durch den Roboter gegebene Einschränkungen sollten daher durch andere Fähigkeiten ausgeglichen werden. Zudem sollte nicht außer acht gelassen werden, dass auch die Umgebung die erwartete Servicequalität beeinflussen kann („Erster Eindruck“).

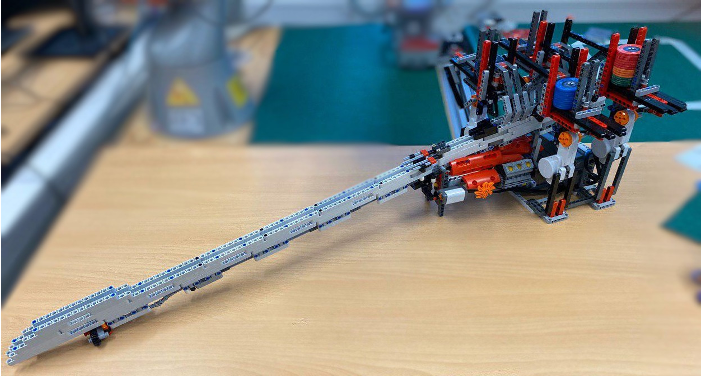

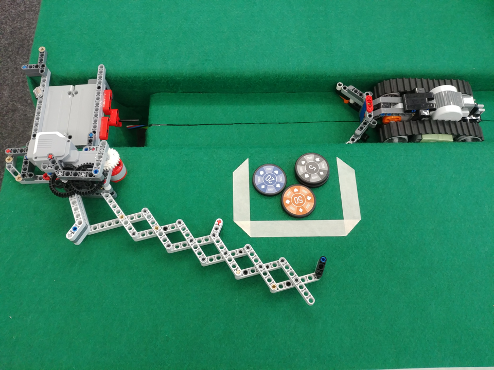

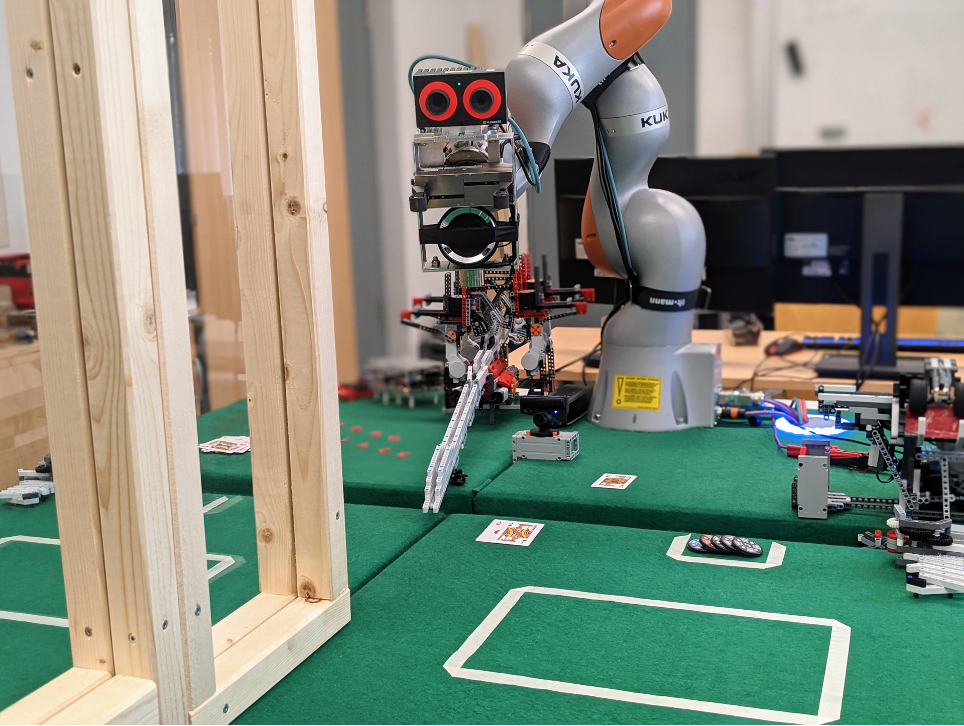

Als Ausgleich für Einschränkungen des Roboters, wie etwa einen langsameren Spielfluss, kommentiert RoboJack gute oder schlechte Spieleraktionen und gibt Tutorials und Tipps für optimale Spielstrategien oder Kartenzählen in BlackJack. Zudem wurde darauf geachtet, dass das vollständige BlackJack-Spiel umgesetzt wird, inklusive echter Karten und Einsätze, sowie aller Spieloptionen, auch kompliziertere wie etwa Pärchen aufzusplitten (es gibt bereits alternative Robotersysteme für BlackJack, diese sind aber in einem oder mehreren dieser Fähigkeiten eingeschränkt).

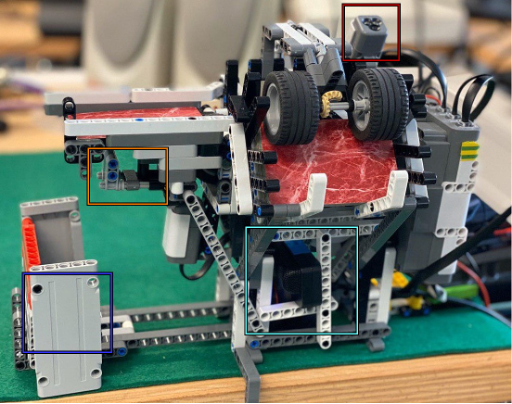

Dabei wurde ein Fokus auf eine technisch interessante Umsetzung beim Umgang mit Karten und Spielchips gelegt, teilweise unterstützt durch Hilfsmaschinen aus Lego, um ein Spielerlebnis anzubieten welches Spieler mit einem menschlichen Dealer so nicht bekommen würden.

Kriterium 5: Intuitive Interaktionen

Dazu gehört unter anderem dass Interaktionen schnell zu erlernen sind, und diese falls möglich, bereits existierenden Standards folgen. Bei der Kommunikation mit Nutzern sollte das Vier-Seiten-Modell beachtet werden, das besagt dass es neben einer inhaltlichen Ebene auch weitere indirekte Kommunikationsebenen gibt. Daraus lässt sich etwa ableiten, dass der Roboter Nutzer während der Kommunikation ansehen, ansonsten ein “Anstarren” aber vermeiden soll, außer es dient als indirekte Handlungsaufforderung. Aber auch kleinere Aspekte fallen unter dieses Kriterium, wie etwa dass das Gesicht des Roboters und die Lautsprecher für Sprachausgabe nah beieinander positioniert sein sollen, damit Nutzer wenn sie ihre Ohren zur Tonquelle ausrichten automatisch den Roboter anschauen.

Neben obigen Punkten gibt RoboJack neuen Nutzern selbständig ein interaktives Spieltutorial und pausiert Bewegungen während der Kommunikation um Geräusche durch die Motoren zu reduzieren, damit Spieler das gesagte besser verstehen.

Kriterium 6: System ist personalisiert

Damit die Nutzer sich besser mit dem System identifizieren können und sich auch wertgeschätzt fühlen soll die Interaktion personalisiert sein. Dazu sollten auch vergangene Interaktionen gespeichert werden, um rückwirkend Bezug darauf nehmen zu können. Außerdem sollte bei einer Personalisierung des Roboters selbst darauf geachtet werden das unter anderem Sprachausgaben und Roboterhandlungen zueinander passen.

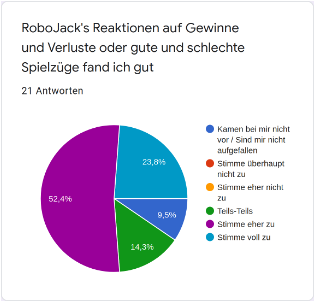

RoboJack verwendet eine Gesichtserkennung um Spieler welcher er anfangs nach ihrem Namen gefragt hat namentlich ansprechen zu können. Zudem merkt sich das System die Aktionen der Spieler um auf gut oder schlecht ausgegangene Spielzüge zu reagieren oder kann zusätzlich Emotionen der Spieler miteinbeziehen. Um dabei einen guten Datenschutz zu gewährleisten funktionieren sämtliche Module vollständig offline.

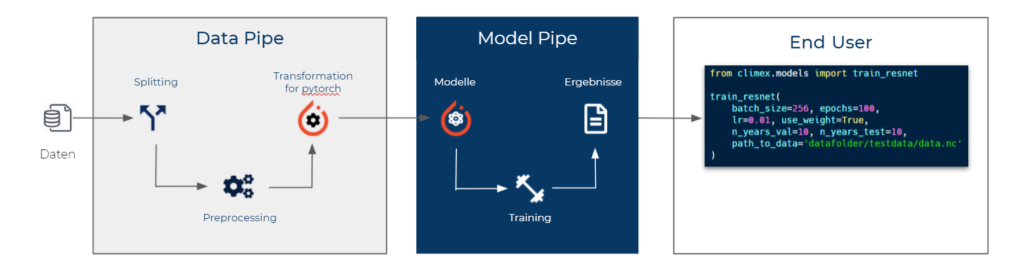

Kriterium 7: System ist modularisiert und portabel

Durch leicht wiederverwendbare Module können sich Synergien mit anderen Projekten ergeben. Zudem soll das System unkompliziert zu starten und verwalten sein und sich möglichst einfach wieder an einem anderen Ort (Kunde/Messe) aufbauen lassen.

Kriterium 8: Nutzerstudie

Eine Nutzerstudie ermöglicht zum einen die Evaluation der umgesetzten Kriterien und zum anderen finden neue Nutzer häufig Problem an die sich Entwickler sich schon gewöhnt haben.

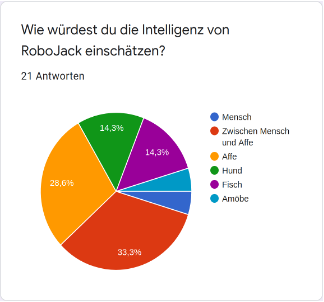

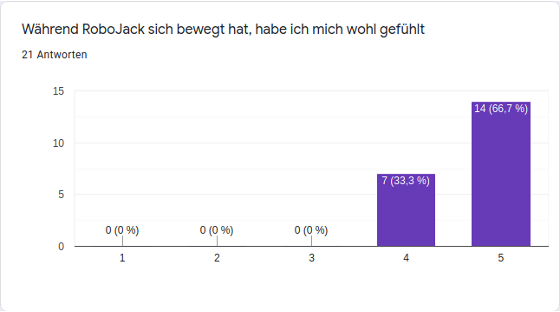

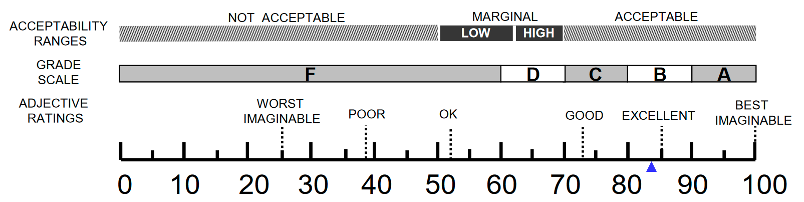

Zum Ende der Arbeit wurde eine Nutzerstudie mit 21 Teilnehmern durchgeführt in welcher sehr gute Ergebnisse erzielt werden konnten. Die Teilnehmer haben die Frage ob sie Spaß beim Spielen hatten durchschnittlich mit 4,7 von 5 möglichen Punkten bewertet. Bei der Frage ob sich die Spieler wohl gefühlt haben während der Roboter bewegt hat, haben alle entweder 4 oder 5 Punkte vergeben. Die Teilnehmer fanden es sehr interessant (4,6) RoboJack bei seinen Aktionen zuzuschauen. Sie würden ein Spiel mit RoboJack auch deutlich weiterempfehlen (4,7), und dass obwohl sie einen durchschnittlichen Verlust von 35 erspielt haben. Häufigster Kritikpunkt war eine zu langsame Spielgeschwindigkeit.

Die mit dem Sytem Usabiltiy Scale (SUS) errechnete Benutzerfreundlichkeit des Systemsvon RoboJack beträgt 83.

Die Nutzerstudie diente dazu zu evaluieren ob die erarbeiteten Kriterien erfolgreich zur Verbesserung von Mensch-Roboter-Interaktionen angewendet werden können, was durch die sehr guten Ergebnisse gezeigt werden konnte. Da die vorgeschlagenen Kriterien nicht auf RoboJack zugeschnitten, sondern möglichst allgemeingültig formuliert wurden, können sie zukünftig verwendet werden, um die Interaktionsqualität in weiteren Mensch-Roboter-Kollaborationsanwendungen zu verbessern.

Team

Daniel Bermuth

Betreuung: Alexander Poeppel

Leiter des Innovationslabors: Prof. Dr. Wolfgang Reif